近日,西北工业大学光电与智能研究院聂飞平教授团队在人工智能领域取得重要进展,在三维点云表征、集成视觉表征、联邦隐私聚类三个方向实现突破。《Reliable-View 2D-3D Key-Part Aligned Transformer with Reinforced Masking for 3D Point Cloud Understanding》、《Towards Federated Clustering: A Client-wise Private Graph Aggregation Framework》、《S²-Boost: Synergistic Semantic Boosting for Coarse-to-Fine Ensemble Learning》3篇相关研究成果被人工智能领域的国际顶级会议AAAI 2026(Association for the Advancement of Artificial Intelligence)(CCF A类会议)录用。上述三项工作均得到国家自然科学基金等项目资助。

基于2D-3D可靠视角联合的关键部位对齐的强化掩膜transformer点云理解

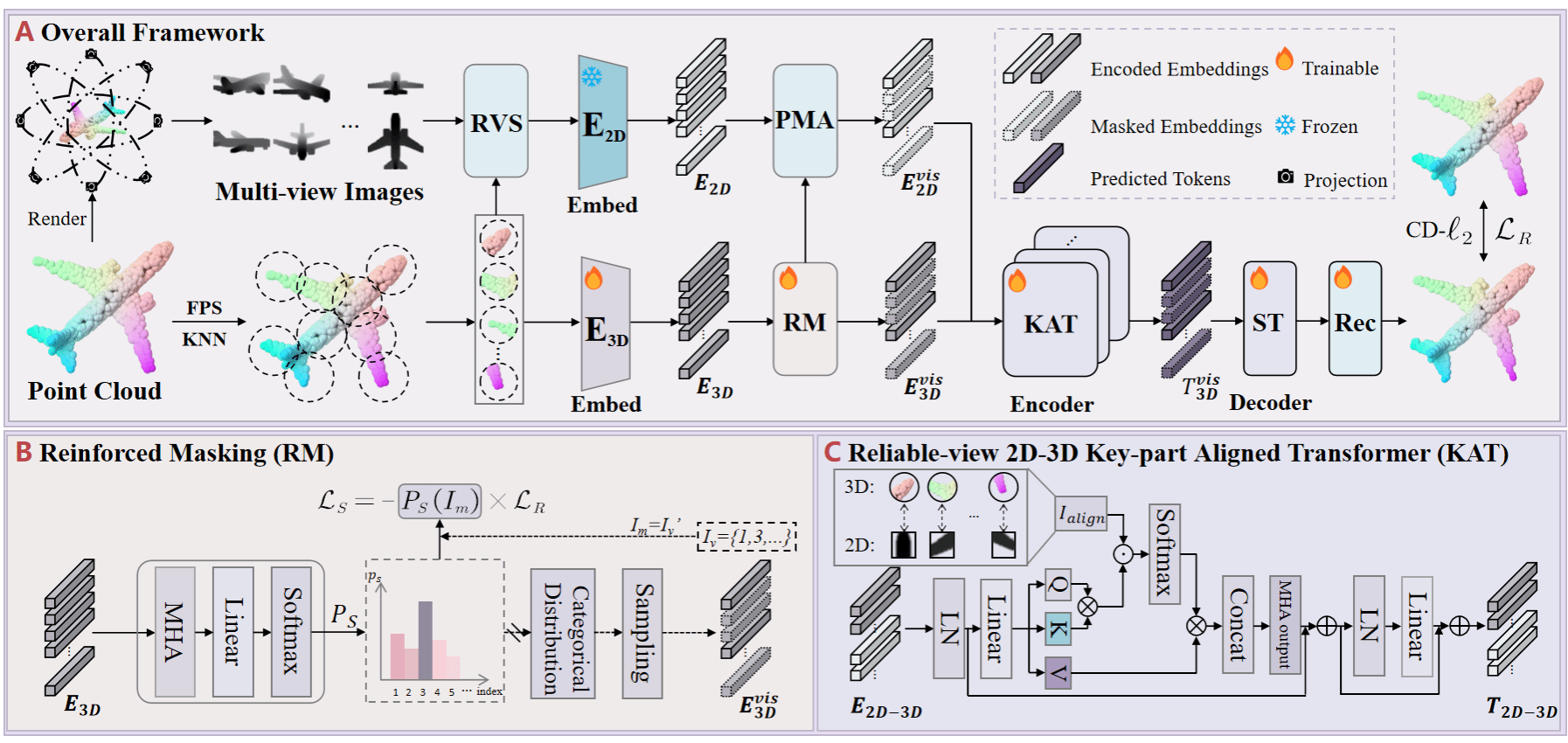

3D点云理解是自动驾驶、机器人感知和增强现实等领域的核心技术,旨在从无序点云中提取语义信息以支持分类、分割等下游任务。然而,点云数据的稀疏性、非结构化特性以及高质量标注的稀缺,为模型训练与泛化带来严峻挑战。现有掩码自编码器方法大多采用随机掩码策略,未能充分考虑点云的空间语义分布,导致重建质量受限,所学表示对复杂几何结构感知不足。针对此,研究团队提出KR-MAE框架,创新性地引入“强化掩膜”机制与“2D-3D可靠视角关键部分对齐”策略。该框架通过梯度奖励驱动的强化学习动态选择语义显著的点云区域(如边缘、角点及复杂曲面)进行掩码,除去信息量低的低频区域。同时,设计可靠多视图选择器,筛选信息丰富的2D视角,并通过局部交叉注意力实现2D图像块与3D点云关键部分的几何对齐。该研究证明,通过强化掩码引导模型关注关键几何结构,并结合多视图纹理信息进行细粒度对齐,能够有效提升3D表示的判别力与泛化能力,为少标注甚至无标注场景下的3D视觉感知提供了新思路。

图1:KR-MAE算法框架图

该成果主要由团队王政副教授指导硕士生靳祥龙在本科毕设阶段完成,王政副教授为通讯作者,作者还包括王榕副教授、聂飞平教授。

基于客户端层私有图聚合框架的联邦聚类

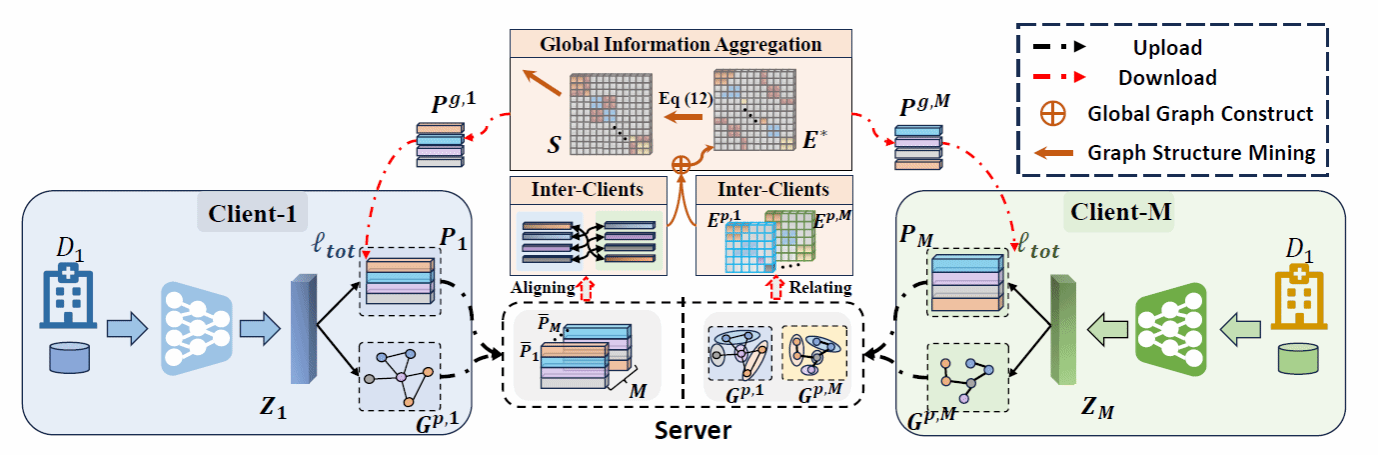

联邦聚类旨在从分散的、无标签的数据中提取模式,但在性能和隐私之间取得平衡极具挑战性。现有方法在传输嵌入表示时存在泄露敏感数据的风险,而仅共享抽象的聚类原型又会导致模型精度下降。针对此,团队提出了基于客户端层私有图聚合框架的联邦聚类(SPP-FGC)。该框架创新性地利用局部结构图作为隐私保护知识共享的主要媒介。在客户端,每个客户端构建一个私有结构图来捕捉内在的数据关系;随后,服务器安全地聚合和对齐这些图,形成一个全面的全局图,并从中导出一个统一的聚类结构。该框架提供一次性完成的“SPP-FGC”模式,适用于快速分析;以及一个迭代优化的“SPP-FGC+”模式,用于处理如图像等更复杂的非结构化数据。实验证明,该框架在保持可证明的隐私保证的同时,聚类精度(以NMI指标为准)相比联邦基线方法有所提高。

图2:SPP-FGC+算法框架图

光电与智能研究院博士生何冠雄为论文第一作者,王政副教授为论文通讯作者,作者还包括王榕副教授、聂飞平教授。

协同语义增强的由粗到细集成学习

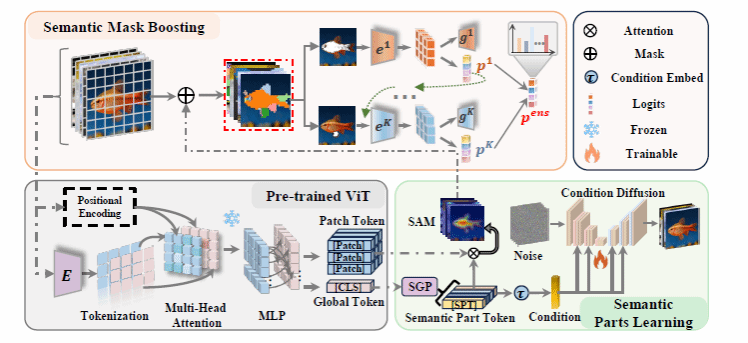

人类的视觉识别是一个从粗到细、逐步整合的层级过程。尽管集成学习借鉴了这一原理,但现有方法通常在决策层面对模型进行整合,忽略了特征空间内丰富的互补信息,从而限制了其潜力。为解决此问题,团队引入了协同语义提升框架(S²-Boost),该框架模仿人类认知过程,将基于部分的语义分解与集成学习的迭代纠错能力相结合。该框架首先通过一个自监督的层次化语义学习模块,将图像自主分解为语义上有意义的互补部分。然后,这些部分将引导一个增强程序,其中一系列专门的学习器分别聚焦于特定的语义分区,协同修正集成模型的错误。该方法不仅提升了模型的性能和鲁棒性,还通过展示每个学习器如何贡献于最终决策,增强了模型的可解释性。

图3:S²-Boost算法框架图

光电与智能研究院博士生何冠雄为论文第一作者,王政副教授为论文通讯作者,作者还包括王榕副教授、聂飞平教授。

(文:何冠雄,审核:赵斌)

搜索

搜索  英文

英文  联系我们

联系我们  首页

首页